こんにちは!

PlayGroundAdventCalendar2024 19日目担当、データコースのYukariです。

近頃はEU,日本を中心としたデータ保護、AIガバナンス、AIの倫理的・法的枠組みについて学んでいます。

こちらの記事では本年、欧州連合理事会にて承認され2026年より本格適用される、世界初の包括的なAI開発運用規制法についてお話していこうと思います。

1. はじめに

近年、AI産業は飛躍的な発展を遂げ、私たちの生活や社会に深い影響を与える存在となりました。その一方で、この急速な発展に伴い、倫理的課題やデータ保護、著作権といった多岐にわたる問題が浮き彫りになりつつあります。

これまでこうした課題に包括的に対応する明確な規制が存在しなかった中で、EU AI Actは、世界で初めての包括的なAI規制法として注目されています。この法律はEU域内を対象としたものですが、その影響はEUを超え、AIを利用する日本を含む世界各国に波及します。本記事ではEU AI Actとは具体的にどのような法律なのか、どういった影響が及ぼされるのかについて紹介・考察していきます。

2. The EU Artificial Intelligence Actとは

EU AI Actとは2021年4月に欧州委員会が提案した世界初の包括的なAI法規制で、2024年3月に採択を得ました。EUのデジタル戦略の要であり、技術革新に重点を置きつつ、AI技術の倫理的で安全な活用を促進し、人権保護や市場の公平性を確保するために設計されました。

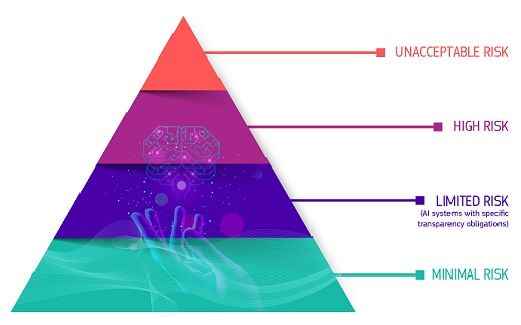

EU AI Actは、AIシステムのリスクレベルに応じた規制を設ける法的枠組みであり、このリスクベースのアプローチは、すべてのAIシステムを一律に規制するのではなく、その用途や影響の重大性に応じて規制を段階的に設けるものです。

1.許容できないリスク(Unacceptable Risk) -原則禁止

人の生命や基本的人権に直接的に脅威をもたらすと考えられるAIシステム。このカテゴリーに該当するシステムは、EU域内での使用が全面的に禁止される。

- 政府によるソーシャルスコアリング(個人の行動や特性に基づいて社会的なスコアを付け、サービスや機会へのアクセスを制限するシステム。)

- 公共空間でのリアルタイム遠隔生体認証(プライバシーを侵害し、不適切な監視や差別に利用される可能性がある生体認証システム。)

2.高リスク(High Risk) -厳格な監査と規制の対象

個人の生活や権利に大きな影響を与える可能性が高いAIシステム。これらのシステムは、厳格な監査と規制を受ける必要があります。

高リスクと特定された AI システムには、次の用途で使用される AI テクノロジーなどが含まれます。

- 国民の生命と健康を危険にさらす可能性のある重要インフラ(例:交通)

- 教育や職業訓練など、教育へのアクセスや職業上の進路を決定する可能性のあるもの(例:試験の採点など)

- 製品の安全コンポーネント(例:ロボット支援手術におけるAIの応用)

- 雇用、労働者の管理、自営業へのアクセス(例:採用手続きのための履歴書ソート・ソフトウェア)

- 必要不可欠な民間および公共サービス(例:市民がローンを組む機会を奪う信用スコアリング)

- 国民の基本的権利を侵害する可能性のある法執行(例:証拠の信頼性評価)

- 移民、亡命、国境管理(例:ビザ申請の自動審査)

- 司法と民主的プロセスの管理(例:裁判判決を検索するAIソリューション)

3. 限定的リスク(Limited Risk) -透明性義務

直接的な危険は少ないが、誤解や悪用を防ぐために透明性の確保が求められるAIシステム。このカテゴリのシステムは、利用者にAIを使用していることを明示する義務があります。

- チャットボット(AIが応答していることを明示する必要あり。カスタマーサポートで使われるチャットボットが、ユーザーに「AIが応答しています」と表示するケース。)

- 感情認識システム(ユーザーの感情や反応を解析するAIシステム。顧客の表情を読み取って広告を最適化するAI搭載のデジタルサイネージ。)

- ディープフェイク(AI生成動画や画像が誤解を招かないよう、「AIで作成されました」というラベルを付けるなど。)

4.最小限のリスク(Minimal Risk)

上記三つ以外の一般的に使用されているAIは規制対象外となります。

- スパムフィルター(電子メールのスパムを自動検出・除去するシステム。)

- 音声アシスタント(スマートフォンやスマートスピーカーの音声認識技術。)

- ビデオゲームAI(ゲーム内キャラクターの行動を制御するシステム。)

現在 EU で使用されている AI システムの大部分は、このカテゴリに該当します。

3. EU AI Actの適用範囲及び罰則

EU AI Actは、AIシステムの安全性と倫理性を確保するために策定された法規制ですが、その管轄や適用範囲はEU域内に留まらず、世界各国に影響を及ぼす可能性があります。

AIシステムの定義

異なるレベルの自律性を持つよう設計され、展開後に適応性を示す可能性がある機械ベースのシステムであり、明示的または暗黙的な目的のために、受け取った入力情報から予測、コンテンツ、推奨、または意思決定といった出力を生成し、それによって物理的または仮想的な環境に影響を与えることができるものを指します。

商業用および非商業用

商業目的のAIシステムだけでなく、非商業目的で使用されるAI(例: 公共サービス向けのAI)も規制の対象です。

対象となる主体

- EU域内の事業者

EU域内でAIを開発、提供、または使用するすべての企業や組織が規制の対象となります。 - EU域外の事業者

EU域外に拠点を置く事業者であっても、以下の場合にはEU AI Actの規制に準拠する必要があります。 - EU市場向けにAI製品やサービスを提供する場合

例:日本の自動車メーカーがEUで販売する自動運転システム。 - EU域内のユーザーを対象とする場合

例:米国の企業がEUユーザー向けにオンラインAIツールを提供。

対象となるAIシステム

EU AI Actは、そのリスクベースのアプローチに基づき、すべてのAIシステムを以下のカテゴリに分類し、適用します。

- 許容できないリスク(Unacceptable Risk)

- 高リスク(High Risk)

- 限定的リスク(Limited Risk)

- 最小限のリスク(Minimal Risk)

これにより、規制はAIの使用用途や影響力に応じて異なる強度で適用されます。

罰則

禁止(許容できないリスク)AI違反

最高35,00万€、または違反者が企業の場合は、前年度会計の全世界の年間総売上高の7%のいずれか高額な方。

高リスクAI、もしくは限定的リスクAI違反

最高15,00万€、または違反者が企業の場合は、前年度会計の全世界の年間総売上高の3%のいずれか高額な方。

第三者認証機関又は国内管轄当局の要請に対する、不正確、不完全又は誤解を招く情報の提供

最高750万€、または違反者が企業の場合は、前年度会計の全世界の年間総売上高の1%のいずれか高額な方。

4. 日本への影響

EU AI Actは生成AIなどの基盤モデルの開発や、AIを活用したサービスの提供を行う幅広い企業を対象としています。これにより、日本企業も以下の対応が求められます。

日本のAI規制の現状

現状の日本では、AIに関する法規制は欧州ほど厳しくありません。政府は「AI戦略会議」を通じて新たな法規制の導入を検討していますが、現時点では具体的な規制は整備されていません。

日本企業への影響と対応

- 安全性と信頼性の確保: AIシステムの安全性や信頼性を確保するための体制整備が必要です。例えば、富士通は2019年に外部の専門家による委員会を設置し、自社のAIの安全性を客観的に評価する体制を整備しています。

- リスク管理の強化: AIの利用に伴うリスクを適切に評価し、管理する体制の構築が求められます。NECは2018年に人権やプライバシーの観点からAIビジネスの戦略を立てる専門組織を設立し、リスク管理の強化を進めています。

5. まとめ

EU AI Actは、AI技術の可能性を最大限に引き出しつつ、そのリスクを適切に管理するための世界初の包括的な規制です。この法律は、倫理的で持続可能なAI社会の実現に向けた重要な一歩となるでしょう。

日本にとっても、EU AI Actを単なる規制と捉えるのではなく、信頼性の高いAI技術を開発するチャンスとして活用することが重要ではないでしょうか。本記事を通じて、EU AI Actについて理解が深まり、AI技術がもたらす未来を考える一助となれば幸いです。

最後までご覧いただき、ありがとうございました。

明日はmiyuさんです。よろしくお願いします!

6. 参考文献

・CORRIGENDUM European Parliament

・AI Act, Shaping Europe's digital future European Commission

・EUでAIの規制法成立 日本企業でも安全性確保へ対応強化 NHK

・The EU Artificial Intelligence Act Up-to-date developments and analyses of the EU AI Act EU Artificial Intelligent Act